特集

こどものSNS規制、先駆けて「禁止」した豪州と、議論を進める各国の動向

【特集 SNS事業者・SNS規制論の現在地】第3回

2026年4月21日 07:00

第1回:米国プラットフォーム事業者に無制限の免責を与えた「通信品位法230条」の功罪と、現在の論点

第2回:EUと日本におけるプラットフォーム規制・デジタル主権の議論に見える、米国とは異なる視点

第3回:こどものSNS規制、先駆けて「禁止」した豪州と、議論を進める各国の動向

広範囲にわたるSNS規制の論点のなかでも、直近、世界中で規制強化が目立つのはこどもの保護に関するものである。各国の規制の強度に大きな差があり、また先行する規制には抜け穴があったり、副作用が生じることも明らかになってきている。

しかしながら規制の方向性自体は、OECD(経済協力開発機構)の「デジタル環境におけるこどもに関するOECD勧告」に則したものとなっており(詳細は後述)、各国、地域で大きな違いは生じていない。そのため、先行事例の状況を確認しながら、ある程度共通した内容に落ち着いていくことが予想される。

本稿では、第1回、第2回の内容も一部振り返りつつ、各国のこどものソーシャルメディアからの保護やSNS規制に関する動向を確認していく。

豪州:世界で初めて16歳未満のSNSを「禁止」に

豪州(オーストラリア)は、2025年12月施行の改正オンライン安全法により、指定した大規模なSNSに対し、16歳未満のアカウント保有を防止するための合理的措置を義務化した。世界初の国家がこどものSNS利用を禁止したものとして話題になっているが、さまざまな問題を提起するものともなっている。

この規制の発端は、SNSにおけるいじめによる自殺に対して、保護者が規制強化を求めたことにある。これを受けて議論された基本的な目的は、各国で議論されている内容と変わらず、違法・有害な情報のこどもへの影響を防止することである。その結果として、一律禁止というもっとも強度の高い規制が施行されることとなった。

一方で抜け穴も顕在化している。アカウントを作らずに閲覧することは可能であり、指定されたSNS以外の規模の小さなSNSのアカウントも急激に増えている。今後、新たに指定されることも予想されるが、いたちごっこになることが考えられる。また年齢確認の方法が指定されておらず、事業者まかせになっており、誤認、年齢詐称などが相次いでいる。

EU:DSAに続き、DFAでさらなる規制強化をはかる

EU全域ではDSA(Digital Service Act:デジタルサービス法)による規制が2024年4月から始まっている。こどもの保護に特化したものではなく、SNSも含むインターネットの仲介事業者に対して違法・有害情報対策を含む利用者の保護を求めるものであり、その中で、未成年者の保護措置等を行うことを義務付けるものとなっている。2025年7月にガイドラインを発行しており、極めて詳細な措置内容が示されている。

また、今年提案されることが見込まれているDFA(Digital Fairness Act:デジタル公正法)案では、DSAより踏み込んだ以下のような内容が議論されている。

- 依存性のある設計の制限(Addictive Design)

こどもの脳の発達やメンタルヘルスに悪影響を与える「やめられなくなる仕組み」である無限スクロールや動画自動再生をデフォルトでオフ、あるいは禁止し、 常にアプリに呼び戻すようなプッシュ通知の頻度も制限する - デジタル成人年齢の導入検討

SNSや特定のデジタルサービスを利用できる年齢について、EU共通の基準を設ける。欧州議会では、保護者の同意なしで利用できる年齢を原則16歳とし、13歳未満はアクセス自体を厳格に制限すべきとする決議案が出ている。また、プライバシーを保護しつつ、実効性のある年齢確認システムの導入をプラットフォームに義務付ける - インフルエンサー・マーケティングの規制

こどもが広告と気づかずに商品を購入したり、価値観を歪められたりするリスクに対処するため、こども向けコンテンツにおけるステルスマーケティングを厳罰化し、こどもの知識不足や無邪気さを利用した、不当な購買意欲の煽り(例:ゲーム内のルートボックス=ガチャなど)を制限する - パーソナライズ広告の禁止

こどものプロファイリングに基づく行動ターゲティング広告を全面的に禁止する

欧州各国:英国オンライン安全法など強い規制も

EU加盟・非加盟を問わず欧州の各国は、独自にこどもの保護に関するSNS規制の検討を進めている。フランスではすでに幼稚園から中学校で携帯電話の使用が禁止されているが、これを高校まで広げること、および15歳未満のSNS利用禁止を2026年9月から施行するための法案審議が始まっていると報道されている。

その他、デンマーク、ノルウェーでも、一定年齢以下の利用禁止や保護者の許可を求める法案の提出が検討されていると伝えられている。

英国でもSNSに特化したものではないが、2023年に成立したオンライン安全法が順次施行されており、2025年5月にはこどもの安全義務が始まっている。施行後にVPN登録者が10倍から18倍に増えたと報じられたり、なりすましなどの回避策も確認されている。また、SNSではなくAIチャットボットとの対話を通じて有害な情報を得るケースが増えている。

これらに対応するための16歳未満のSNS利用禁止を盛り込んだ法案修正案は、2026年3月に否決されているが、代替案として年齢確認の厳格化や無限スクロールの制限などが議論されている。

米国:州レベルでも青少年保護の法整備の動き

米国では、連邦レベルでCOPPA 2.0(Children and Teens’ Online Privacy Protection Act 2.0:児童・青少年オンラインプライバシー保護法)およびKIDS Act (Kids Internet and Digital Safety Act)が審議の最終段階にある。さらには、州レベルでも成立または審議中の規制が数多くある。

COPPA 2.0

米国の現行法COPPAを改正し、対象を13歳未満から16歳未満に拡大するものである。SNSに特化したものではないが、オンライン上の個人情報保護について規制を強化する法案となっている。主な内容はターゲティング広告の禁止、利用者の同意なしのデータ収集禁止、個人情報を削除する消去ボタン導入の義務付けなどである。また、事業者が利用者がこどもであることを明確に知っている場合だけでなく、客観的に見てこどもが利用していることが明らかな場合にも規制を適用し、知らなかったと主張できる抜け穴を塞ごうともしている。

KIDS Act

こちらはSNSやゲーム会社に特化した法案で、審議が続いていたKOSA(Kids Online Safety Act:児童オンライン安全法)を修正し、フェンタニル対策、AI警告に関する法案など、複数の個別法案も含めたパッケージとなっている。主なSNSに対する規制内容は以下である。

- オンライン上の危害からの保護

アルゴリズムがこどもを依存させたり、いじめ、薬物、自傷行為などを助長したりするのを防ぐための対策をプラットフォームに義務付ける - ペアレンタルコントロールの強化

保護者がこどものアカウント設定、プライバシー、利用時間などを容易に管理・制限できるツールを提供することを義務付ける - 年齢確認と透明性

アプリストアでの年齢確認の義務化やAIチャットボットが関与している場合の明示、広告ラベルの義務付けなど

COPPA 2.0とKIDS Actに含まれている大半の法案は上院を通過し、下院での審議が行われている。世論の強い圧力もあって成立の可能性は高いと見られていたが、政党間での主張の違いが表面化しており、先行きが少し不透明になってきている。

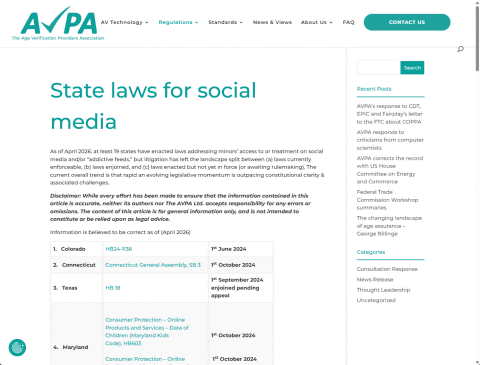

各州の動向

非営利の国際業界団体AVPAによると2026年4月時点で、すでに19州でなんらかの規制が成立している。ただし、差し止め命令が出ているものや訴訟中のものが半数程度あり、またその判決内容にもばらつきが見られる。

米国は憲法修正第1条による表現の自由を極めて重視していること、また通信品位法230条によりコンテンツの内容については事業者の責任が免責されることから、SNS利用の禁止については差し止めとなる場合がほとんどである。一方で、依存症や中毒を生じさせると考えられるAIによるレコメンドなどのアルゴリズム、無限スクロールや動画自動再生などの設計については、製造物責任が認められる判決が出始めている。今後は連邦法であるCOPPA 2.0、KIDS Actが成立した場合に、どのように整合性を取るのか、各州バラバラのパッチワークになってしまうのかなども課題となるだろう。

日本:動き出しは早かったが現在は慎重な議論

日本におけるこどもの保護に関する法制度は世界でも早い方で、青少年インターネット環境整備法が2009年4月に施行されている。18歳未満への有害情報のフィルタリング機能の実装や周知に関する義務化がおもな規制内容となっている。近年の海外の事例と大きく異なる点は、利用の禁止や事業者に一方的な年齢制限による規律を課すものではないということである。基本的な視点は年齢に応じたリテラシーの向上をめざすものであり、SNS事業者ではなく携帯電話会社、アプリストアやOS事業者が用意したフィルタリング機能を、保護者とこどもが相談の上利用することを求めることが中心となっている。

また、対象とされているリスクが限られており、こどもへの性被害、誹謗中傷などのいじめ(被害だけでなく加害者となることも含む)、長時間利用によるメンタルヘルスへの影響など、今日危険視されている多くの問題が解決されていない。そのため、より実効的な環境整備法の改正(2027年が目標)、新たな法的枠組みの必要性が議論されている。ただし、利用禁止といった無菌状態に置くとリテラシーが醸成されず、大人になった際にいきなりインターネットが解禁されるのはかえって危険であると同時に、インターネットの正しく有用な利用が阻害されるとして、慎重な議論となっている。

2026年の夏頃にとりまとめが行われる予定であるが、海外の事例に鑑みると、ターゲティング広告の規制、ペアレンタルコントロールの実装、デフォルト設定による安全機能(大人との交流の制限、位置情報やプロフィールの通知制限など)の実装など、SNS事業者やOS事業者に対する規制が強化されると予想される。また、基本的な視点であるリテラシー向上についても、教育現場や保護者に対してだけではなく、関係するステークホルダー全てに対して協力することについて強化されるであろう。

また、リテラシー向上についても年齢に応じたものとすることが重要とされており、年齢ごとに規律の強度を変えることも検討されている。

これらの議論において極めて重要となる法改正がもうひとつある。2026年の個人情報保護法の改正では、こどもの個人情報を取り扱う場合に保護者の同意や通知が義務化される予定である。16歳未満が対象とされており、他の法律で成人年齢を18歳としていることと異なる点も混乱を招く恐れがあるが、それ以上に年齢による義務化が法律で制定されることによる年齢確認が課題になる。

こどもの利用が多いSNSやチャット機能のあるゲームなどでは、個人情報を取り扱っている場合は年齢確認が必須となる。本人申告だけでは足りないとする議論が大勢を占めつつあるが、全ての場合に適用できる方法は確立されていない。将来的には、マイナンバーカードやマイナポータルのアプリに収斂していくことが予想されるが、当面は他のさまざまな方法を組み合わせることとなり、この点でも事業者の負担は大きくなるだろう。

今後の各国の動向

各国・地域の具体的な規制内容は、強度にこそ大きな差異はあるものの、基本的な目的はほぼ同じである。

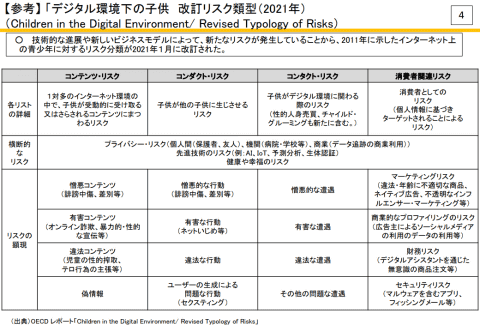

こどもを保護しつつ健全な成長を促進するためには、一定の制限が必要であるとする考えは、「デジタル環境におけるこどもに関するOECD勧告」(2012年発表、2021年改定)がベースとなっており、各国の規制でもこの勧告に基づく政策が進められている。この勧告ではリスク類型が具体的に提示されており、AI、プロフィリング等の技術的なリスクについても指摘されている。

また、この勧告をもとにデジタルサービスプロバイダーに向けたOECDガイドラインが公表されており、チャイルドセーフティー・バイデザイン、情報の提供と透明性、プライバシー、データ保護、商用利用、ガバナンスとアカウンタビリティの項目ごとに具体的な対応方法が示されている。

世界各国で進むSNS規制は、概ねこのリスクへの対応とガイドラインで示されたSNS事業者が取るべき対策の実現に沿ったものとなっている。ただし、重きを置くポイントと規制の強度が大きく異なっている。その違いの原因は、こどもの権利における保護と尊重のどちらを重視するか、健全な成長の促進をどのように実現するかの違いにあると考えていいだろう。

現在、被害の拡大に対して急進的かつ一律的な規制が先行しているが、これらはリテラシーの向上やこどもの権利より保護を重視したものとなっており、批判も少なくない。また、拙速感は否めず、迂回やダークサイドへ追い込む危険性も指摘されており、健全な成長をむしろ妨げる恐れもある。そのため、先行事例の状況を見極めながら、本来あるべき姿を模索する状況がしばらく続くのではないかと考えられる。